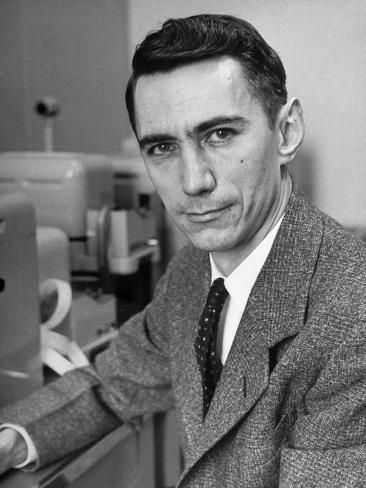

Claude Shannon: conheça o pai da teoria da informação

Atualizado em: 22/12/2023

Talvez você não tenha ouvido falar em Claude Elwood Shannon, mas saiba que ele teve grande influência para você estar lendo este texto agora. O matemático estadunidense é conhecido como nada menos que o pai da teoria da informação, e completaria 105 anos hoje (30). Suas descobertas lançaram as bases para a indústria de computadores e para as telecomunicações, isso há mais de 50 anos. Foi a partir de uma fórmula sua que a transmissão de informações passou a ocorrer de maneira muito mais eficiente.

A matemática dos computadores

Nos anos 40, Shannon trabalhou como pesquisador na Bell Telephone Laboratories, laboratório criado pelo próprio inventor do telefone, Graham Bell. E foi lá, em 1948, que ele descobriu o que hoje rege todos os computadores do mundo: a situação de “sim-não”. O matemático identificou que a unidade básica de informação é essa, e que ela pode ser expressada por meio da álgebra binária booleana com os números 0 e 1. 0 é “não”, ou “desligado”, e 1 é “sim”, ou “ligado”. Ou seja, na informática basta conjuntos de 0 e 1 e você pode fazer qualquer coisa!

O pai do bit

A partir da descoberta da unidade básica de informação, Shannon apresentou ao mundo os bits que conhecemos hoje. A sigla, que significa binary digit (dígito binário), corresponde justamente à menor unidade de informação, e pode ser 0 ou 1. Em um computador, todas as informações processadas são medidas e codificadas em bits. E os famosos bytes, mega, giga e tera nada mais são do que vários bits combinados entre si.

Shannon mostrou como medir a quantidade de informação, revelando que cada canal de comunicação possui uma velocidade-limite, que, se ultrapassada, terá uma transmissão poluída por erros.

Antes do matemático, era utilizado pelos engenheiros o sistema de numeração decimal. Foi graças às suas constatações fazendo uso do sistema binário, deixando os circuitos mais simples e baratos, que Shannon provou a possibilidade de construir um computador totalmente eletrônico. “Este foi o ponto de partida para a construção de computadores digitais: a capacidade de um circuito elétrico realizar operações e armazenar informações”, descreve o resumo de sua biografia no Instituto de Física da USP.

Curiosidade e empenho

Claude Shannon estudou matemática e engenharia elétrica na Universidade de Michigan, em 1936, e fez mestrado e doutorado no Instituto de Tecnologia de Massachusetts (MIT). Seus estudos em conjunto com o matemático Warren Weaver deram origem à teoria da informação. Essa área de estudo tem justamente o objetivo de analisar a quantificação, armazenamento e comunicação da informação. A Era da Informação que vivemos hoje não existiria sem Claude Shannon.